“DNA digital storage” verwijst naar elke mogelijkheid om digitale data op te slaan in DNA, dat is geproduceerd door gebruik te maken van “commercially available oligonucleotide synthesis machines for storage and DNA sequencing machines for retrieval”. Het opslagsysteem in DNA is veel compacter dan de huidige magnetische tape of hard drives, omdat de dichtheid van DNA vele malen groter is. Het heeft ook een erg lang leven, zodat de data in stand blijven, tenminste zolang het DNA op een koude, droge en donkere plaats wordt beheerd. Aangezien DNA een universeel en fundamenteel biologisch opslagmechanisme is, is de kans op onleesbaarheid van het medium in de toekomst niet zo heel erg groot (afhankelijk uiteraard van de bewaarcondities). Onderzoekers noemen de opslagmethode “apocalypse-proof” omdat “after a hypothetical global disaster, future generations might eventually find the stores and be able to read them.” Het is echter ook een erg langzame methode want “the DNA needs to be sequenced in order to retrieve the data”. De methode is dus vooral interessant voor data die een lage retrieval graad hebben, weinig worden gebruikt dus, zoals grote hoeveelheden wetenschappelijke data of “long-term archival data”. Over dat laatste s te discussiëren, maar een interessante opslagmethode is het in ieder geval.

Hieronder staat een korte presentatie van Nick Goldman, van het European Bioinformatics Institute, waarin het hele procede van DNA opslag uit de doeken wordt gedaan. Zeer interessant en het kijken waard. Het duurt iets langer dan een kwartier en de kijker weet dan in ieder geval meer dan dat het erg duur is.

Category Archives: Information Retrieval

iOn the Future: University of Washington

Toegang to betrouwbare informatie is een van de belangrijkste fundamenten van een zich ontwikkelende maatschappij. Elke dag is het nodig dat we informatie ontvangen en ter beschikking stellen via toegankelijke en veilige systemen. Deze ‘reclamefilm’ van de University of Washington (en m.n. van de Information School) laat zien hoe in de universiteit de informatiemaatshappij benaderd wordt en hoe informatie toegankelijk wordt gehouden. Interessante video…

Linking Open Data

Het volgende diagram visualiseert de datasets die in de Linked Open Data Cloud zijn opgenomen met hun relaties. Iedere node in dit diagram representeert een identificeerbare dataset, die als Linked Data is gepubliceerd. Linked Open Data betekent dat de datasets herbruikbaar zijn en gedownload kunnen worden via de Datahub. De laatste versie van dit diagram dateert van september 2011.

Informatie gepubliceerd als Linked Open Data stimuleert het hergebruik van data, omdat je zelf zoveel mogelijk verwijzingen aanbrengt naar kennisbronnen elders en omdat anderen gemakkelijk naar jouw informatie kunnen verwijzen.

Wikipedia definieert Linked Data als ‘a term used to describe a recommended best practice for exposing, sharing, and connecting pieces of data, information, and knowledge on the Semantic Web using URIs and RDF’.

Voor wetenschappelijke datasets betekent dit dat uitgevoerd onderzoek kan worden geverifieerd op nasis van de ‘open’ onderzoeksdata. Dat is een belangrijk middel om wetenschappelijk wangedrag tegen te gaan, maar ook om uitgevoerd onderzoek ‘her-uitvoerbaar’ te maken. Het komt de betrouwbaarheid van onderzoek ten goede.

Door op het diagram te klikken wordt een interactieve versie geactiveerd, die het mogelijkmaakt om via elke node van het diagram bij de specifieke data en databeschrijving op de datahub uit te komen. Op die manier zijn de data te bekijken via een preview, zijn kleinere bestanden als een voorbeeld van het bestand te dowbloaden en kan de totale dataset worden gedownload.

By Richard Cyganiak en Anja Jentzsch

Datamining en de toekomst

Eric Horvitz van Microsoft Research en Kira Radinsky van het Israëlische Technion-instituut gebruiken software om de digitale archieven van de New York Times en online archieven door te spitten. Ze doen dit in de hoop patronen te ontdekken die het mogelijk maken toekomstige ontwikkelingen rondom bijvoorbeeld humanitaire rampen te voorspellen.

De software die ze ontwikkeld hebben doorzoekt behalve 22 jaar aan digitale krantenarchieven van de New York Times ook bronnen als Wikipedia en andere internetsites. Ze zijn met name op zoek naar berichtgeving rondom rampen, ongelukken en rellen. Dergelijke data-mining wordt al langer gedaan, maar voor dit soort onderwerpen gebeurt dat meestal door personen.

De software die ze ontwikkeld hebben doorzoekt behalve 22 jaar aan digitale krantenarchieven van de New York Times ook bronnen als Wikipedia en andere internetsites. Ze zijn met name op zoek naar berichtgeving rondom rampen, ongelukken en rellen. Dergelijke data-mining wordt al langer gedaan, maar voor dit soort onderwerpen gebeurt dat meestal door personen.

Volgens de onderzoekers heeft het gebruik van software om digitale archieven te doorzoeken diverse voordelen boven menselijk onderzoek. Zo kan software makkelijk patronen ontdekken in grote hoeveelheden data, doorzoekt software ook bronnen waar onderzoekers niet aan toe komen, en signaleert de software ook verhalen die de voorpagina’s niet gehaald hebben maar toch belangrijk kunnen zijn in een ontwikkeling. Een van de problemen die de onderzoekers tegenkwamen, was het feit dat lang niet over alle tragische gebeurtenissen uit Afrika uitgebreide berichtgeving is.

Digging into data

Drie projecten waarin Nederlandse onderzoekers participeren, ontvangen subsidie uit de ‘Digging into Data Challenge’. De Challenge stond open voor transatlantische, innovatieve samenwerkingsverbanden uit de informatica, geesteswetenschappen en cultureel erfgoed, die zich richten op grootschalige data-analyse.

Drie projecten waarin Nederlandse onderzoekers participeren, ontvangen subsidie uit de ‘Digging into Data Challenge’. De Challenge stond open voor transatlantische, innovatieve samenwerkingsverbanden uit de informatica, geesteswetenschappen en cultureel erfgoed, die zich richten op grootschalige data-analyse.

De algemene vraagstelling van de Digging into Data Challenge was geconcentreerd rond grote databestanden in de sociale wetenschappen. Immers: steeds meer data – denk aan onderzoeksgegevens, economische data, maar ook kranten en audiovisueel materiaal – uit de geesteswetenschappen en het cultureel erfgoed worden gedigitaliseerd. Hoe maak je die databestanden efficiënt toegankelijk ? Hoe voer je een goede kwantitatieve analyse uit ? Welke vragen stel je aan het materiaal en tot welke nieuwe inzichten leiden die ?

Google in video: evolutie in zoeken en een engine

Vandaag een aantal (recente) filmpjes van en over Google. Ze gaan alle over Search en Google’s search engine. Het zijn (korte) films die een blik bieden op het denken binnen Google over hun kernactivteit: zoeken, de activiteit waarmee het bedrijf groot geworden is. Voor een blik op de geschiedenis van Google klik hier.

How to use Google search as a professional

Oracle en ‘big data’

Oracle introduceert de Oracle Big Data Appliance. Dit is volgens de leverancier een gecombineerd hard- en softwaresysteem dat klanten moet helpen bij het maximaliseren van de waarde van de grote hoeveelheden data (‘big data‘) die ze in huis hebben. Dit maakte de leverancier bekend op de jaarlijkse conferentie Oracle OpenWorld, die dit jaar wordt gehouden in San Francisco.

Oracle introduceert de Oracle Big Data Appliance. Dit is volgens de leverancier een gecombineerd hard- en softwaresysteem dat klanten moet helpen bij het maximaliseren van de waarde van de grote hoeveelheden data (‘big data‘) die ze in huis hebben. Dit maakte de leverancier bekend op de jaarlijkse conferentie Oracle OpenWorld, die dit jaar wordt gehouden in San Francisco.

Weblogs, social media-feeds, ‘smart meters’, sensoren en andere toepassingen genereren hoeveelheden data (doorgaans gedefinieerd als ‘big data’) die volgens Oracle niet gemakkelijk toegankelijk zijn voor de huidige datawarehouses en business intelligence-applicaties. De Oracle Big Data Appliance, in combinatie met de Oracle Exadata Database Machine en de nieuwe Oracle Exalytics Business Intelligence Machine, biedt klanten een oplossing voor big data en levert alles wat ze nodig hebben voor het verkrijgen, organiseren, analyseren en maximaliseren van de waarde van big data binnen hun onderneming, aldus Oracle.

Information Revolution

De vakantietijd is aangebroken. De komende weken (veelal ook de komkommertijd als het gaat om nieuws) vullen we deze website regelmatig aan, maar niet zozeer met tekst- en nieuwsberichten als wel met films die op de een of ander manier voor ons van belang zijn. Deze films worden regelmatig gebruikt in het onderwijs, maar sommige zijn juist voor ons vakgebied van groot belang en verdienen dan ook een brede bekendheid. De komende weken zullen we dan ook een aantal van deze films met een korte introductie hier publiceren. Veel plezier !

We starten vandaag met een voor de meeste lezers waarschijnlijk niet onbekende film, ‘Information Re/volution’. Deze film onderzoekt de veranderingen in de wijzen waarop we informatie vinden, opslaan, maken, beoordelen en delen. Het is een stimulerende film om na te denken over de nabije toekomst van de informatievoorziening en de vaardigheden die dan nodig zijn voor het beheren, evalueren en creëren van informatie.

Google manipuleert toch zoekresultaten

10 maart 2011

Google geeft toe whitelists te gebruiken om handmatig zoekalgoritmes te manipuleren. Eerder ontkende de zoekgigant dit in een verweer tegen een Europees antitrustonderzoek. Volgens Search Engine Land zei Matt Cutts, het hoofd van Google’s spambestrijdingsteam, dat Google uitzonderingslijsten gebruikt die effect hebben op sommige sites waarvan de ranking wordt beïnvloed door een bepaalde algoritme terwijl dit niet de bedoeling was. Volgens Cutts ‘there is no global whitelist but for some algorithms that have a negative impact on a site in Google’s search results, Google may make an exception for individual sites’. Welke sites door het handmatige whitelisten immuun worden gemaakt voor welk algoritme, houdt Google geheim. Dat is een opmerkelijke uitspraak. Na een recente grote aanpassing van de zoekalgoritmes zei Cutts tegen hetzelfde Search Engine Land dat er geen sprake was van whitlists of blacklists om handmatig bepaalde sites toch te bevoordelen of te benadelen. Deze zogenaamde ‘Farmer Update’ van het zoekalgoritme is gericht op het wegdrukken van ‘link farms’ uit de zoekresultaten. Het gaat dan om sites die content schrijven op opkomende zoektermen om zo hoog in de resultaten terecht te komen. De content op die sites is van lage kwaliteit, en om de ‘artikelen’ heen staat een woud aan advertenties.

Microsoft’s Bing pleegt plagiaat

1 februari 2011

Bing kopieert automatisch de zoekresultaten van Google en presenteert die als zijn eigen. Google heeft met een slimme ‘undercoveractie’ zijn rivaal Bing betrapt op zoekplagiaat. Bing blijkt te leunen op een inventief, maar tegelijk weinig origineel algoritme: het volautomatisch kopiëren van Google’s zoekresultaten. Bing blijkt via tools als Suggested Sites en de Bing Bar zoektermen én resultaten van Google te oogsten. De volgorde van resultaten wordt vervolgens één op één gekopieerd en in Bing gepresenteerd. Vanaf november blijkt dat Bing ineens veel vaker precies dezelfde zoekresultaten weergeeft als Google. Google vertrouwde de zaak niet en zette verschillende vallen. En daar tuinde de kloonbot van Bing met open ogen in. Google creëerde speciale en totaal niet relevante zoekresultaten op bizarre en unieke zoektermen als ‘hiybbprqag’, puur als valkuil. Binnen korte tijd had Google beet: Bing toonde ook het onzinnige zoekresultaten bij dezelfde zoektermen. En, zoals Search Engine Land stelt, ‘as a result of the apparent monitoring, Bing’s relevancy is potentially improving (or getting worse) on the back of Google’s own work. Google likens it to the digital equivalent of Bing leaning over during an exam and copying off of Google’s test’.

Zoekmachines trekken eigen diensten voor

20 januari 2011

Een aantal zoekmachines trekken de eigen diensten voor in de zoekresultaten die zij bieden. Zo vinden gebruikers van Google eerder Gmail als gezocht wordt op ‘e-mail’ dan bij concurrenten. Dat blijkt uit onderzoek van Harvard-professor Ben Edelman. Edelman onderzocht 32 zoektermen zoals e-mail, calendar en maps bij vijf zoekmachines (Google, Yahoo, Bing, Ask en AOL). De data werd verzameld in de maand augustus van vorig jaar. Google heeft altijd ontkend dat eigen diensten voorrang krijgen in de zoekresultaten. Toch is Google samen met Yahoo het bedrijf dat de meest afwijkende zoekresultaten biedt in vergelijking met de gebruikelijke algoritmes. Google linkt meer dan drie keer zo vaak naar eigen diensten als andere zoekmachines naar de diensten van Google linken. Als gekeken wordt naar de zoekterm e-mail ziet de top drie van Google er als volgt uit: mail.google.com, www.mail.com en mail.yahoo.com. Bij Yahoo stuitten gebruikers respectievelijk op mail.yahoo.com, www.mail.com en www.gmail.com. Hetzelfde is waar te nemen bij de zoekterm mail.

Monk brengt oude handschriften digitaal in beeld

1 november 2010

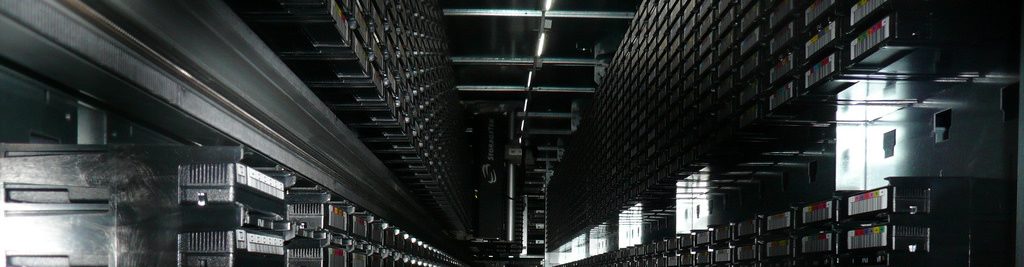

Het Target project, het grootste publiek-private ICT project in Nederland, heeft een uniek testbed opgeleverd. Het testbed kan nu 1,5 petabytes (1 petabyte = 1.000.000 gigabytes) aan data opslaan en verwerken en zal uiteindelijk een capaciteit hebben van maar liefst 10 petabytes – een hoeveelheid data gelijk aan een stapel DVD’s met een hoogte van 30 x de Martinitoren. Het Target testbed bestaat uit een grote hoeveelheid harde schijven en tapes, die samen één groot opslagsysteem vormen. Het bijzondere aan het Target testbed is het feit dat schijven (en tapes) zich op vier verschillende locaties (storage pools) bevinden in verschillende systemen. Door een ‘state of the art’ netwerk en de gecombineerde kracht van deze systemen ontstaat een zeer snel opslagsysteem met een grote opslagcapaciteit. Deze enorme verwerkingscapaciteit maakt het Target testbed uniek in de wereld. Target is in eerste instantie geïnitieerd door toepassingen binnen de sterrenkunde, één van deze toepassingen is de Lofar radiotelescoop, van stichting Astron. Lofar is ‘s werelds grootste radiotelescoop, bestaande uit lage frequentie antennes die verspreid staan over Noord-Oost Nederland en Europa. Astron zal het testbed gebruiken voor de opslag van de gigantische hoeveelheid gegevens van Lofar in het Lofar Long Term Archief.

Browseroorlog in nieuwe fase ?

6 oktober 2010

Het marktaandeel van Internet Explorer is wereldwijd onder de 50 procent gedoken. In Europa daalde het marktaandeel tot 40 procent, vooral door het verplichte browserkeuzescherm in Windows. Twee jaar geleden had Internet Explorer (IE), de browser van Microsoft, wereldwijd nog een marktaandeel van 67 procent. Dat aandeel daalde in september naar 49,87 procent en zelfs naar 40,26 procent in Europa, zo blijkt uit statistieken van StatCounter. In Europa heeft Firefox Internet Explorer bijna ingehaald. Het aandeel van de open source browser bleef steken op 38,97 procent, een verschil van iets meer dan een procent. Wereldwijd is dat gat groter en loopt Firefox met 31,5 procent marktaandeel nog bijna twintig procent achter op IE. Google Chrome is intussen bezig met een flinke opmars. Het marktaandeel is wereldwijd meer dan verdriedubbeld sinds september 2009 van 3,69 procent naar 11,54 procent in september dit jaar. In Europa steeg het gebruik van Chrome van 3,14 procent vorig jaar naar 11,32 procent afgelopen maand.

Database Cracking zal zoekresultaten versnellen

2 juli 2010

Onderzoeker Stratos Idreos van het Centrum Wiskunde & Informatica (CWI) in Amsterdam heeft een techniek ontwikkeld om grote databestanden sneller te doorzoeken. Hij noemt zijn methode ‘database cracking’. Daarbij wordt bij elke zoekopdracht de data opnieuw gesorteerd. Daardoor ontstaat een steeds betere sortering en kan bij elke volgende zoekopdracht het antwoord sneller worden gevonden. Binnen de databasetechnologie worden zoekopdracht meestal uitgevoerd via index-structuren. Daarbij wordt vantevoren een zoekindex opgezet en vastgelegd. Idreos claimt de eerste techniek ontwikkeld te hebben waarbij het databasesysteem de rol van de beheerder overneemt. Idreos verdedigt zijn proefschrift 24 juni 2010 aan de Universiteit van Amsterdam.

Vrije Universiteit: gegevens lekken. Welnee, het staat bewust open, hoor !

9 februari 2010

De VU heeft de verbinding met het eigen intranet beveiligd met https en het bezoeken van de 'voordeur' van de site levert slechts de inlogpagina op. Via Google zijn achterliggende pagina's echter toegankelijk. Komt men zo binnen dan kan een surfer rustig op op andere links klikken en daarmee een deel van het intranet bekijken. Het gaat om het deel 'Medezeggenschap' van de Ondernemingsraad van de universiteit. Daar zijn naast vergaderverslagen en planningen ook de adviezen van de Ondernemingsraad te vinden en het stappenplan bij reorganisaties. Verder zijn er zaken toegankelijk als het interne adresboek van de hele universiteit, en de samenstellingen van de diverse commissies en werkgroepen. Ook zijn er intern gepubliceerde fotoreportages van uitjes en borrels in te zien. In een eerste reactie vraagt woordvoerder Ronald van Gelder zich af of er inderdaad iets aan de hand is. Hij vertelt dat hij de IT-afdeling van de VU in zal lichten, zodat die actie kan ondernemen. 'Voor zover dat de bedoeling is'. Van Gelder stelt dat de toegankelijkheid van het interne adresboek geen probleem is; dat is langs andere wegen al in te zien.

Google begint synoniemen te begrijpen

20 januari 2010

Google stelt dat het de manier verbeterd heeft waarop haar zoekmachine synoniemen begrijpt. Semantisch zoeken of kunstmatige intelligentie: het begrijpen van synoniemen is iets dat nieuwe zoekmachines, zoals Haika, Yebol en Microsoft's Powerset (de basis van Bing) graag willen ontwikkelen. Of, zoals Clint Boulton zegt, 'if a user searches for information about how to develop photographs using coffee grinds as a developing agent, a search engine needs to understand that words such as photos and pictures could also be relevant'. Op 19 januari liet Google weten dat het de manier waarop de Google-zoekmachine met synoniemen omgaat verbeterd heeft en dat haar pogingen om zoekdiensten te laten denken als mensen een stap dichterbij gekomen zijn. Zoekmachines moeten onderscheid kunnen aanbrengen tussen woorden met dezelfde betekenis. Google's engineers hebben meer dan vijf jaar onderzoek gedaan naar het 'synonyms system', waarmee het 'analyzes synonyms' impact and quality', zo schreef Steven Baker in een blog. 'Our systems analyze petabytes of Web documents and historical search data to understand what words can mean in different contexts'. En het bedrijf ontdekte dat 'synonyms affect 70 percent of user searches across the more than 100 languages Google supports', zo stelt Baker.

Heisa over metadata

23 december 2005

In Windows Vista (dat eind 2006 uitkomt) krijgen gebruikers de mogelijkheid om zelf allerlei metadata aan bestanden toe te voegen, zoals trefwoorden, meningen, opmerkingen, status van afhandeling, e.d.. Analisten van Gartner waarschuwen voor de gevolgen daarvan. Het is immers reeds vaker voorgekomen dat aanwezige metadata in documenten voor ongewenste openbaarmaking van informatie zorgden, zo stellen Michael Silver en Neil MacDonald. In een onderzoek naar de metadata-functionaliteit van Vista wijzen ze op bijvoorbeeld de contracten: stel dat een gebruiker in de metadata een tag ‘trouwe klant’ of ‘slechte betaler’ aanmaakt. ‘If such a contract is sent to the customer with the keyword still attached, it could cause embarrassment or even loss of business’, aldus de analisten.