31 juli 2008

Google ontdekte dat het Web wel heel erg groot aan het worden is. Volgens het bedrijf heeft ze onlangs meer dan een biljard unieke URL's op het Web getraceerd. 'This milestone awed our search engineers, who are seeing the Web growing by several billion individual pages every day', zo werd door Google-woordvoerders in een blog posting gemeld. Google nam tegelijkertijd de gelegenheid te baat om de scope en omvang van haar index te promoten. 'We don't index every one of those trillion pages — many of them are similar to each other, or represent auto-generated content … that isn't very useful to searchers. But we're proud to have the most comprehensive index of any search engine, and our goal always has been to index all the world's data', zo schreven Jesse Alpert en Nissan Hajaj, software engineers in het Web Search Infrastructure Team van Google. Het is al een hele tijd terug dat Google publiekelijk iets gezegd heeft over de omvang van haar index, een onderwerp dat voor enkele jaren voor een fikse controverse zorgde tussen de grote zoekmachinebedrijven. De strijd om de omvang van de index tussen Google en Yahoo is nog berucht ! Die controverse kwam tot een eind toen duidelijk werd dat de meeste gebruikers bijna nooit meer dan twee pagina's webresultaten scannen. Waar het dus om gaat is het leveren van 10 tot 20 echt relevante weblinks of, nog beter, van een direct feitelijk antwoord. Er zijn weinig mensen die door 5000 mogelijke resultaten zullen scannen om het antwoord te vinden.

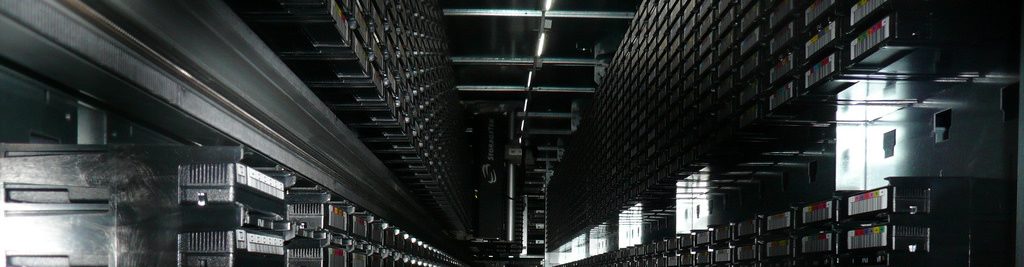

Nu wordt het interessant om te zien of de andere webgiganten reageren op deze uitdaging van Google. Google openbaarde echter ook interessante informatie over hoe en met welke frequentie het deze links analyseert. 'Today, Google downloads the web continuously, collecting updated page information and re-processing the entire web-link graph several times per day. This graph of one trillion URLs is similar to a map made up of one trillion intersections. So multiple times every day, we do the computational equivalent of fully exploring every intersection of every road in the United States. Except it'd be a map about 50,000 times as big as the U.S., with 50,000 times as many roads and intersections', zo luidt een melding in de blog. Het probleem met zo'n melding is dat het moeilijk te verifieren is. En waarschijnlijk is het niet eens compleet, zoals in de blog zelf wordt aangegeven: 'So how many unique pages does the web really contain? We don't know; we don't have time to look at them all! 🙂 Strictly speaking, the number of pages out there is infinite — for example, web calendars may have a "next day" link, and we could follow that link forever, each time finding a "new" page. We're not doing that, obviously, since there would be little benefit to you. But this example shows that the size of the web really depends on your definition of what's a useful page, and there is no exact answer'. Het aantal pagina's in de indez van Google is gegroeid in een enorm tempo, van 26 miljoen pagina's in 1998, 1 miljard in 2000 naar 1 biljard nu. 'The new technologies and their penetration has enabled absolutely that any web user (without any knowledge of HTML) can generate dozens and hundreds of pages almost without doing anything unusual – simply by creating profiles on various social networks and using a number of internet applications frequently', zo stelt een analist. Met de groei van de index met verschillende miljoenen pagina's per dag is een volgende mijlpaal binnen enkele jaren bereikt. Om al die biljard pagina's te bezoeken is een mensenleven te kort: met een bezoektijd van 10 seconden per pagina zijn er 115.740.740 dagen (ongeveer 317 jaren) voor nodig. Dat zal zeker niet gaan lukken. Nodig is het ook niet, tenminste: als de zoekmachine maar relevante zoektesultaten geeft. Hoe minder websites bezocht hoeven te worden hoe beter het is….