IBM bouwt voor een onbekende klant een opslagunit waarop 120PB aan data past. Daarmee is het veel groter dan het grootste (bekende) opslagsysteem tot nu toe. De opslag wordt gemaakt met 200.000 harde schijven van ieder gemiddeld 600GB. Door alle harde schijven aan elkaar te koppelen wordt een opslagunit gemaakt met 120 petabyte aan geheugen. De klant wil met de enorme hoeveelheid opslag gedetailleerde simulaties maken van situaties in de werkelijkheid.

IBM bouwt voor een onbekende klant een opslagunit waarop 120PB aan data past. Daarmee is het veel groter dan het grootste (bekende) opslagsysteem tot nu toe. De opslag wordt gemaakt met 200.000 harde schijven van ieder gemiddeld 600GB. Door alle harde schijven aan elkaar te koppelen wordt een opslagunit gemaakt met 120 petabyte aan geheugen. De klant wil met de enorme hoeveelheid opslag gedetailleerde simulaties maken van situaties in de werkelijkheid.

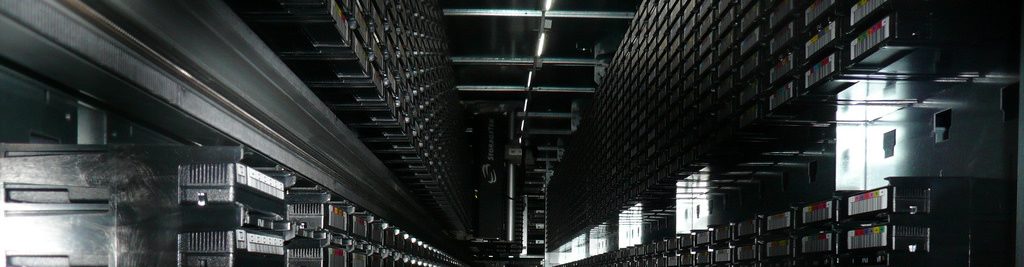

De schijven zullen worden geplaatst in horizontale lades in hoge rekken, maar koeling moet worden gedaan door water, omdat er niet genoeg ruimte is voor meer traditionele koelmethoden. De opslag is voldoende om zestig keer de hele database van internetarchief Wayback Machine te bevatten.

De schijven zullen gebruik maken van IBM’s eigen bestandssysteem GPFS, het General Parallel File System. Dat gebruikt IBM vaker bij grote opslagsystemen. Met 120PB is de opslag vier keer zo groot als MSS van Ncar voor opslag van wetenschappelijke data. Het is onbekend of het daadwerkelijk het grootste opslagsysteem tot nog toe is.

Deze gigantische datacontainer kan 1 triljoen files opslaan en biedt de ruimte voor ingewikkelde simulaties van complexe systemen, zoals weer- en klimaatmodellen. ‘The new technologies developed to build such a large repository could enable similar systems for more conventional commercial computing’, zegt Bruce Hillsberg, directeur van ‘storage research’ bij IBM en leider van het project. ‘This 120 petabyte system is on the lunatic fringe now, but in a few years it may be that all cloud computing systems are like it’, zegt Hillsberg. ‘Just keeping track of the names, types, and other attributes of the files stored in the system will consume around two petabytes of its capacity’.

Het systeem profiteert van het GPFS, dat door IBM is ontwikkeld om supercomputers een veel snellere toegang tot de data te bieden. Volgens Hillsberg ‘it spreads individual files across multiple disks so that many parts of a file can be read or written at the same time. GPFS also enables a large system to keep track of its many files without laboriously scanning through every one. Last month a team from IBM used GPFS to index 10 billion files in 43 minutes, effortlessly breaking the previous record of one billion files scanned in three hours’.

Het systeem profiteert van het GPFS, dat door IBM is ontwikkeld om supercomputers een veel snellere toegang tot de data te bieden. Volgens Hillsberg ‘it spreads individual files across multiple disks so that many parts of a file can be read or written at the same time. GPFS also enables a large system to keep track of its many files without laboriously scanning through every one. Last month a team from IBM used GPFS to index 10 billion files in 43 minutes, effortlessly breaking the previous record of one billion files scanned in three hours’.

Volgens Steve Conway, onderzoeksdirecteur bij IDC, zijn ‘software improvements like those being developed for GPFS and disk recovery are crucial to enabling such giant data drives, because in order to be practical, they must become not only bigger, but also faster. Hard disks are not becoming faster or more reliable in proportion to the demands for more storage, so software must make up the difference’.